머신러닝에서 분류 문제를 해결하기 위한 대표적인 알고리즘으로는 로지스틱 회귀(Logistic Regression)와 서포트 벡터 머신(Support Vector Machine, SVM)을 예로 들 수 있습니다. 두 알고리즘 모두 지도 학습(supervised learning)의 일종으로, 입력 데이터를 바탕으로 결과를 예측하는 데 사용되고 있습니다. 그러나 동작 원리, 수학적 기반, 성능 특성에서 차이가 있어서, 데이터의 특성과 문제 유형에 따라 적절한 알고리즘을 선택하는 것이 중요합니다. 이번 글에서는 로지스틱 회귀와 SVM의 개념과 특징을 설명하고, 실제로 어떤 상황에서 어떤 알고리즘이 더 적합한지 한 번 비교해 보겠습니다.

1. 로지스틱 회귀의 특징과 활용

로지스틱 회귀는 분류 문제를 해결하기 위한 통계 기반의 기법으로, 회귀라는 이름이 붙어 있지만 실제로는 분류(Classification)에 사용됩니다. 입력 값들의 가중합을 시그모이드 함수에 통과시켜 0과 1 사이의 값을 출력하고, 이를 기준으로 특정 클래스에 속할 확률을 예측하게 됩니다. 이를 간단한 수식을 통해 살펴보면 다음과 같습니다. 로지스틱 회귀는 다음과 같은 형태의 함수를 사용합니다:

σ(z) = 1 / (1 + e^(-z))여기에서 z는 입력 벡터와 가중치 벡터의 내적 결과이며, σ는 시그모이드 함수입니다. 이 함수를 통해 출력값은 0과 1 사이로 제한되며, 일반적으로 0.5를 기준으로 두 클래스 중 하나로 분류합니다.

로지스틱 회귀는 특히 변수 간 관계가 선형적일 때 매우 효과적이며, 학습 속도도 빠르고 구현이 쉬워서 실무에서 자주 사용됩니다. 예를 들어, 고객의 구매 여부 예측, 이탈률 예측, 이메일 스팸 여부 판별 등에 많이 활용됩니다. 또한 확률 기반 출력으로 해석이 쉬워서, 결과에 대한 설명력이 중요할 때 유용합니다.

다음은 로지스틱 회귀를 사용하는 간단한 Python 코드 예제입니다. scikit-learn 라이브러리를 사용하여 이진 분류 문제를 해결하여 줍니다. 아래의 예제로 함께 살펴보겠습니다.

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split

from sklearn.datasets import load_iris

# 데이터 로드

iris = load_iris()

X = iris.data

y = (iris.target == 0).astype(int) # Setosa 여부만 분류

# 훈련/테스트 분할

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 모델 훈련

model = LogisticRegression()

model.fit(X_train, y_train)

# 예측 및 정확도 출력

accuracy = model.score(X_test, y_test)

print(f"Logistic Regression Accuracy: {accuracy:.2f}")

2. SVM의 원리와 강점

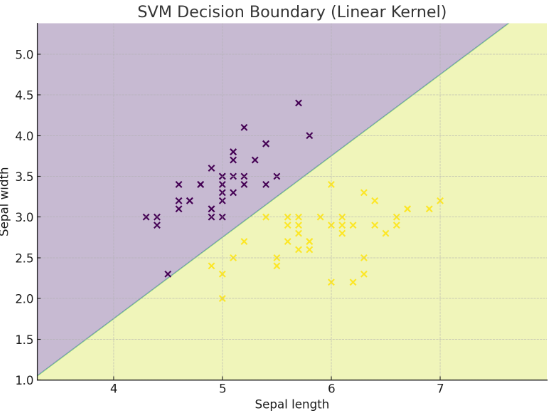

SVM은 통계적 학습 이론에 기반하여 개발된 강력한 분류 알고리즘입니다. 핵심 아이디어는 가장 넓은 폭의 마진(Margin)을 가진 초평면(Hyperplane)을 찾아 데이터를 분리하는 것입니다. SVM은 선형적으로 분리 가능한 데이터뿐 아니라, 커널(Kernel) 함수를 이용해 비선형 분류 문제까지도 효과적으로 처리할 수 있다는 점에서 강력한 성능을 보입니다.

SVM에서 가장 중요한 개념 중 하나는 '서포트 벡터'입니다. 이들은 결정 경계에 가장 가까이 위치한 학습 데이터 포인트로, 이 점들에 의해 최적의 초평면이 결정됩니다. 실제로 대부분의 데이터는 서포트 벡터가 아니며, 이로 인해 모델은 상대적으로 일반화 성능이 좋습니다.

SVM은 특히 차원이 높은 데이터에서도 좋은 성능을 내며, 과적합(overfitting)에 대한 저항력이 강한 것이 특징입니다. 예를 들어, 텍스트 분류나 얼굴 인식, 생물정보학 분야에서의 유전자 분류 등 복잡하고 고차원적인 데이터에 효과적입니다.

다음은 SVM을 사용한 분류 문제 해결의 Python 코드 예제입니다. 역시 scikit-learn 라이브러리를 사용합니다. 아래의 예제로 함께 살펴보겠습니다.

from sklearn.svm import SVC

from sklearn.model_selection import train_test_split

from sklearn.datasets import load_iris

# 데이터 로드

iris = load_iris()

X = iris.data

y = (iris.target == 0).astype(int) # Setosa 여부만 분류

# 훈련/테스트 분할

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 모델 훈련 (선형 커널 사용)

model = SVC(kernel='linear')

model.fit(X_train, y_train)

# 예측 및 정확도 출력

accuracy = model.score(X_test, y_test)

print(f"SVM Accuracy: {accuracy:.2f}")

3. Logistic Regression vs SVM: 상황별 선택 기준

로지스틱 회귀와 SVM 중 어떤 알고리즘을 선택할지는 주어진 문제의 특성과 데이터의 구조에 따라 달라집니다. 간단히 말해서는, 데이터가 선형적으로 분리 가능하고 빠른 예측이 필요한 경우 로지스틱 회귀가 적합하며, 복잡하고 고차원적인 데이터에 대해서는 SVM이 뛰어난 성능을 보일 수 있습니다.

예를 들어, 설명력이 중요한 비즈니스 애플리케이션에서는 로지스틱 회귀의 확률 기반 출력과 모델 해석력이 큰 장점이 됩니다. 반면, 이미지 분류와 같이 고차원 특징이 많은 데이터에서는 SVM의 마진 기반 최적화가 더 좋은 결과를 가져올 수 있습니다. 특히 커널을 활용한 SVM은 비선형 분류에 매우 강력하다는 장점이 있습니다.

또한 학습 시간과 리소스 면에서도 고려가 필요합니다. 로지스틱 회귀는 상대적으로 빠르게 학습되며, 대용량 데이터를 다룰 때도 부담이 적습니다. 반면, SVM은 커널 기법을 사용할 경우 계산량이 증가하여 학습 시간이 길어질 수 있습니다. 따라서 문제의 크기, 리소스 제한, 예측 정확도와 해석력의 우선순위를 고려하여 선택하는 것이 현명하다고 할 수 있겠습니다.